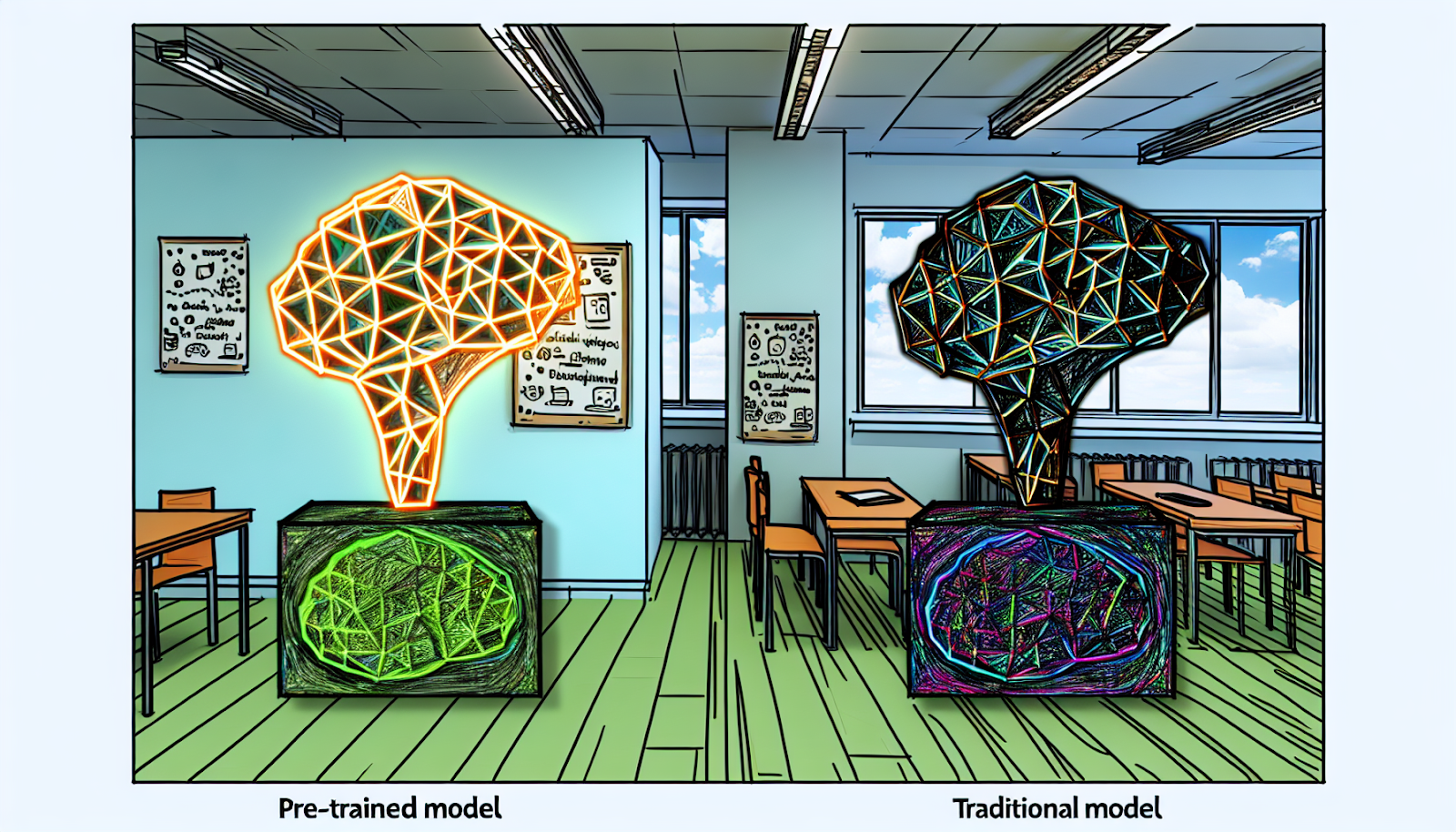

生成預訓練模型與傳統機器學習模型有何不同?

在當今科技飛速發展的時代,人工智慧(AI)和機器學習(ML)已成為各行各業的重要工具。這些技術不僅改變了我們的生活方式,還深刻影響著企業運營的方式。然而,生成預訓練模型(Pre-trained Generative Models)和傳統機器學習模型之間的區別,對許多人來說仍然是一個未解之謎。在這篇文章中,我們將深入探討這兩種模型的不同之處,以及它們各自的應用場景。

一、什麼是生成預訓練模型?

生成預訓練模型是近年來AI領域的一項重要突破。這類模型通常基於深度學習框架,通過大量數據進行預訓練,以獲得對語言、圖像或其他數據形式的基本理解。這些模型經常被用於自然語言處理(NLP)、圖像生成等領域,並且以其強大的生成能力而聞名。

1.1 預訓練階段

在預訓練階段,模型會接觸到大量無標籤的數據,這使得它能夠學習到數據中的潛在模式和結構。這一過程不需要人工標記,因此能夠快速且經濟地處理海量數據。

1.2 微調階段

在完成預訓練後,生成預訓練模型可以進行微調,以適應特定任務需求。這一階段通常需要較少的標記數據,並且能夠在短時間內達到較高的準確度。

二、傳統機器學習模型概述

傳統機器學習模型則依賴於有標籤數據進行訓練。這些模型通常需要人工標記的大量數據集,以便在訓練過程中進行監督學習。常見的傳統機器學習算法包括決策樹、隨機森林、支持向量機(SVM)等。

2.1 監督學習

監督學習是傳統機器學習的一個重要特徵。在這種方法中,模型通過已知輸入與輸出對的數據集進行訓練,以便能夠預測未知數據的輸出。

2.2 特徵工程

特徵工程在傳統機器學習中扮演著關鍵角色。這一過程涉及從原始數據中提取有意義的特徵,以提高模型的性能。然而,特徵工程通常需要專家知識,並且耗時費力。

三、兩者之間的主要差異

生成預訓練模型和傳統機器學習模型在多方面存在顯著差異。

3.1 數據需求

生成預訓練模型通常需要大量無標籤數據進行預訓練,而傳統機器學習模型則依賴於有標籤數據。這意味著生成預訓練模型更容易獲得數據資源,但也需要更強大的計算能力來處理這些數據。

3.2 計算資源

生成預訓練模型由於其複雜性和規模龐大,通常需要更高的計算資源。相比之下,傳統機器學習模型相對輕量級,對硬件要求較低。

3.3 應用範圍

生成預訓練模型在自然語言處理、圖像生成等領域表現突出,而傳統機器學習模型則廣泛應用於分類、回歸等任務。

四、應用案例分析

為了更好地理解兩者的不同,我們來看看一些實際應用案例。

4.1 自然語言處理中的應用

生成預訓練模型如GPT-3已被廣泛應用於文本生成、翻譯等任務,其優越的語言理解能力為其贏得了廣泛讚譽。而傳統機器學習模型則更多地用於文本分類,如垃圾郵件檢測等。

4.2 圖像識別中的應用

在圖像識別領域,生成預訓練模型可以創建逼真的圖像,而傳統機器學習模型則更多地用於圖像分類,如人臉識別等。

五、未來展望

展望未來,生成預訓練模型和傳統機器學習模型將繼續共存並互補。隨著技術的不斷進步,這兩種模型將在更多領域中找到新的應用場景。

六、結論

總結來說,生成預訓練模型和傳統機器學習模型各有其優勢和局限。理解它們之間的差異,有助於我們在不同情境下選擇合適的技術解決方案。隨著AI技術的不斷演進,我們有理由相信,這些工具將繼續為我們帶來創新和變革。